In The Loop 产业观察:2023 五问大模型

上个月 Founder Park 举办了大模型创业者行业大会 ,除了邀请到了王小川、周鸿祎、傅盛等行业大佬,还有来自 Stability、HuggingFace、智谱、BentoML、Jina 等正身处在行业一线探索的技术产品专家、投资人分享他们目前的行业见解。In The Loop 有幸参加了这次大会,在现场充分感受到了这一波大模型行业发展的喧嚣与活力。正式开始之前,可以感受下现场的暖场视频,通过 AI 作词作曲与演唱,让自己热个身。

大模型行业发展很快,当 In The Loop 还在码字编写参会观察的时候,经过一个月的时间,整个行业又往前走了很多,个人认知也不得不随之演进。本文并不打算事无巨细地按照大会的议程来介绍整个会场情况,这一点上 Founder Park 和极客公园官方公众号已经做得很棒了,目前已经整理出大部分演讲报告,大家可以直接前往阅读:

- 百川智能王小川:大模型创业 100 天,我确认找到了属于我的「无人区」

- 「姜子牙」大模型背后,一个专业 AI 团队的进化

- 360 周鸿祎:大模型不是「原子弹」,而是「AK47」

- 傅盛的 AI-Native 创业思考:所有创业者都要相信,这就是最好的时代

- 无法想象全闭源的世界:AGI 大会上的开源讨论

- RWKV:一个大模型小团队,要做 AI 时代的安卓

- AI-Native 的产品要怎么做?追求自然交互,忘记过去的包袱

- 圆桌讨论:AI 与游戏行业的变化

- 沸腾 251 天,访谈近百位从业者,关于大模型世界的 5 个现状

本文尝试从问题出发,结合大会的讨论以及行业最近的发展,去理解和分析当前大模型行业中的大家都在思考什么问题。大会演讲者他们所处的行业位置、业务类型都不太一样,因此对于同一个问题往往有各自独特的认知,甚至有些时候同一个问题的答案完全相反。这样对比来看,从问题出发,或许能够获得另一种观察的体验。

好的问题,有时候比答案更重要

TLDR

- 本文所有的资料来自于互联网公开信息,仅代表此刻 In The Loop 的当前认知,与本人雇主的观点无关。

- 本文作为 In The Loop 产业观察的第一篇习作,尝试去行业研究的角度去帮助读者了解大模型行业的发展趋势。作为程序员,本文的结构可能相对随性,也不如专业的行业研究那般框架严谨。欢迎评论与拍砖,一条批评胜过百条赞美。

- 相比上一篇面向程序员和开发者的 State of GPT: A Programmer’s Perspective ,本文会尽可能减少太多技术细节的讨论,更多侧重从宏观角度看整个行业上下游产业链各方的动作与思考。

- 本文作者目前也身处大模型行业中,如果你也对大模型感兴趣,欢迎关注 In The Loop 与我交流。

- 本文相对较长,全文共 8616 字,阅读预计需要 15 分钟左右。建议关注、收藏后观看。

闲话少说,我们开始。

LLaMA 2 之后,大模型创业公司能有多卷

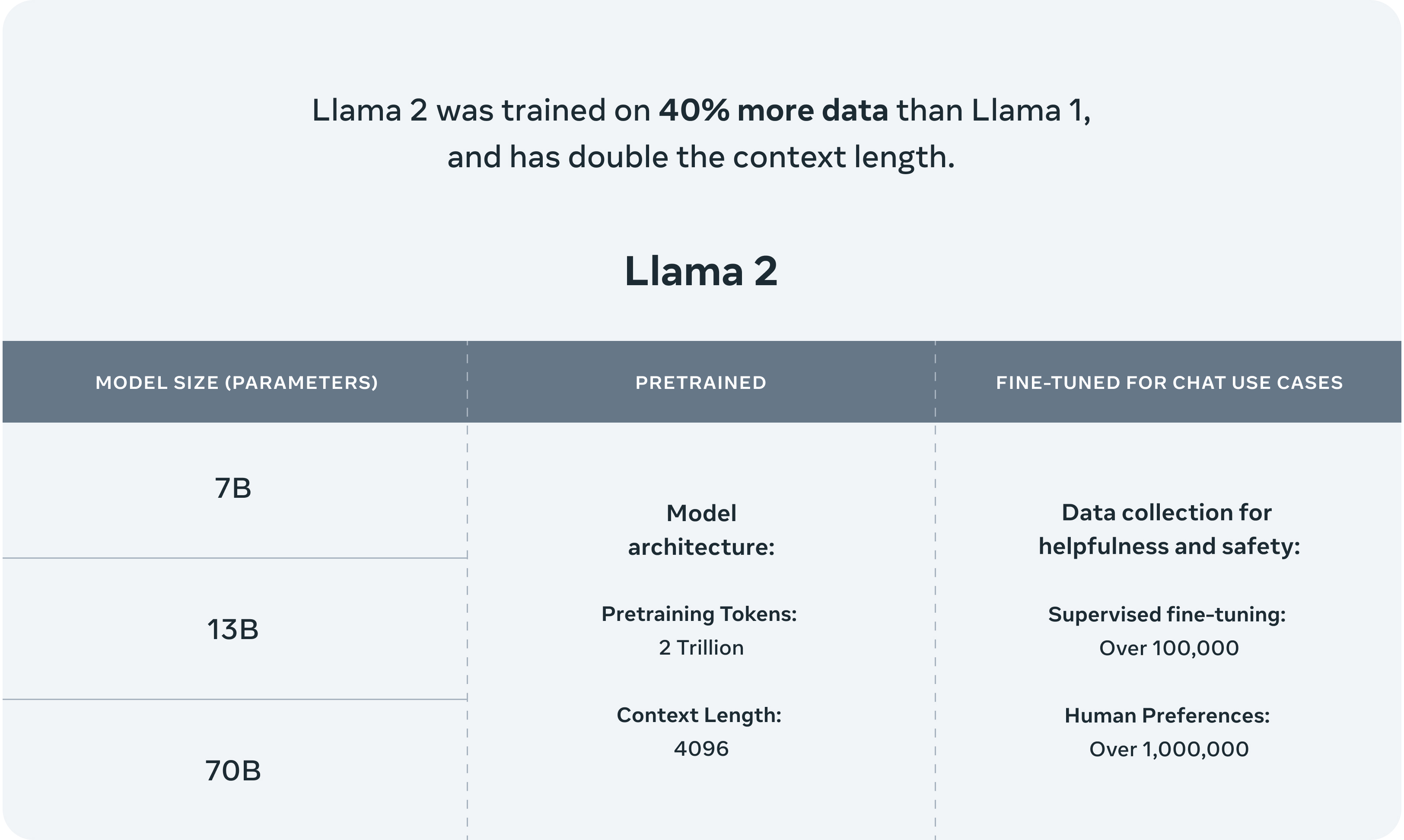

就在 Found Park AGI 2023 大会的前几天,Meta 宣布开源 LLaMA 2 1,并迅速引发大量关注。如果说 LLaMA 1 的开源时 Meta 多少还有点忸怩之态,LLaMA 2 的开源则完全展示了 Meta 在开源大模型的野望。

70B 的 LLaMA 2 模型已经达到了接近 GPT 3.5 的水平,成为第一个免费、开源且足够商用的大模型底座。LLaMA 2 的开源迅速改变了整个行业,正如猎豹 CEO 傅盛所言,「这一下不知道多少公司笑醒在深夜,多少公司哭晕在厕所」。

一方面,之前选择 OpenAI 的 GPT-4 接口做商业化开发的一些应用公司开始考虑选择使用 LLaMA 2。另一方面,LLaMA 2 为大模型开源社区设置了新的里程碑,大幅提升了自研 Foundation Model 的门槛。当投入了巨大的人力与资金去训练自己的 Foundation Model,结果其表现还不如 Meta 开源的 LLaMA 2,很多公司的决策层自然会考虑自己是否还有必要继续自研大模型,而是转而选择成为端到端的应用公司,结合自己积累的行业数据,完成商业上的闭环。

除了快速演进的大模型开源社区,当前的市场环境也给大模型创业公司带来了足够的挑战与考验。在中美关系进一步遇冷的当下,美元基金的投资相比上一波 AI 浪潮急剧减少,另一方面人民币基金的钱也并不太好拿,实际上市场上能够投给大模型的钱并不算太多。进一步的,仅有的这些钱也越来越向 Minimax、智谱和百川等这些头部创业公司,留给更晚入场的公司的机会与时间也越来越少。

对于目前那些已经拿到巨额投资的头部公司,要想继续留在牌桌上也并不容易,他们需要进一步证明自己的技术实力。对于动辄估值就突破上亿美元的大模型创业公司,无论是算力还是人才都需要巨大的资金投入。如果不能在 2023 年底做出 GPT 3.5 水平的模型,公司的技术水平、组织模式与管理水平都会受到非常大的质疑。

即使是已经做出了接近 GPT 3.5 水平的创业公司,还需要进一步在应用层面证明自己,显示出其商业化的潜力。时移世易,目前国内大模型创业已经不像上一波 AI 浪潮一样——几个很厉害的算法科学家,凭借自己优秀科研履历背景就可以拿到大把的钱,拿钱之后也可以比较自在的做前沿算法研究,而不太需要考虑应用的问题。之前在商汤、旷视等这些明星 AI 创业公司遭遇的算法与模型落地困境,大模型投资高企的门槛,快速变化和发展的技术,加之当前相对较差的经济环境,让投资者对于大模型投资采取了更为审慎的态度。大模型热度确实很高,投资人都在非常积极的看这个赛道,「是个人都在做大模型 👀」,但是出手实际上很理智2。

就在本文发布的前几天,字节宣布了自己的大模型应用 「豆包」开放公测。紧随字节,快手也宣布了自研大语言模型「快意」,并基于此在快手 APP 开放了「快手 AI 对话」功能内测。算上之前已经入场的百度文心、阿里通义、华为盘古,还有目前内部正在积极研发的腾讯混元,国内科技大厂已经全部就位。

正如百川智能的王小川所言,尽管现在国内百模大战十分热闹与喧嚣,留给所有大模型公司的船票只有五张。大模型战役正在进行中,两年内围绕着 Foundation Model 的战役或可看到最后获胜的赢家。

中国跟美国不太一样,美国通用大模型闭源模型其实头部几家已经定下来了,OpenAI,Google 都有一张门票,在美国做开源大模型做通用已经没有悬念,投资也不会再去投。但是在中国不是,中国谁做最好的大模型现在并没有结论,有一个大家争取的机会,而且还不一定落在大厂里面。

船票的话现在依然还是有 5 张,如果只有 2 张我们也会在这个船上。这 5 张并不扣除大公司,创业公司是没有 5 张船票的。

To B 还是 To C,大模型创业该如何突围

在大模型创业中,一个摆在人们眼前很重要的问题是:做大模型,究竟应该做 To B 还是应该 To C。对于这个问题,不同的公司,不同的人给出了完全不同的答案。

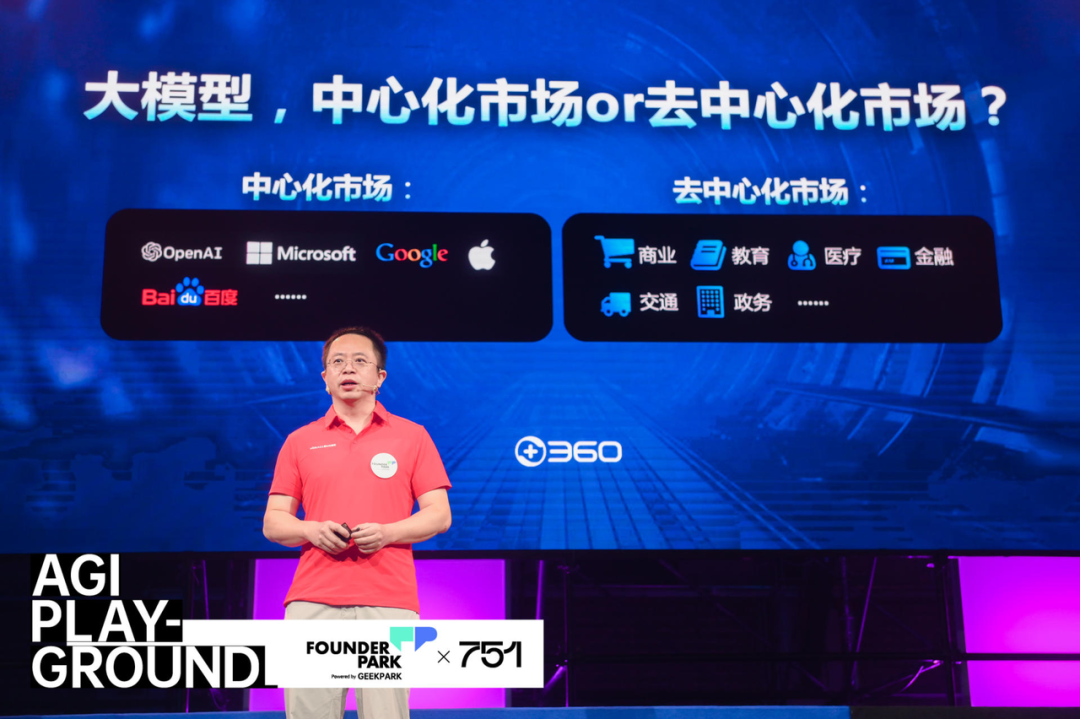

360 创始人周鸿祎给出的答案是,创业者目前最应该关注 To B 的企业级市场。其核心论据在于,当前以字节和腾讯为代表的互联网巨头已经占据了基本所有的 To C 场景,他们会基于平台的巨大优势迅速在 To C 场景部署自己的大模型,这块领域创业者的机会不大。

相对应的,非中心化市场的政府部门、企业对于大模型也存在着巨大的需求,但是因为对于行业数据的保护和目前通用大模型缺乏行业和企业内部的知识等原因,政府和企业对于将大模型应用于自己的场景存在着很多顾虑。因此,如果能够面向特定的企业场景,解决数据安全和大模型部署等问题,让大模型能够理解企业的 know-how,创业者在垂直领域的大模型是有着巨大的机会。

现在创业者应该做什么?做垂直大模型。我们讲创业方法论,创业团队要算力没算力,要钱也不够多,要人才也不够厚。跟这些巨头竞争相比,你唯一的机会是把你所有的资源聚焦在一根针上,才能形成非常大的压强。垂直大模型,是创业者的「金光大道」。

红衣教主的这番言论自然与 360 这几年深耕政企安全业务紧密相连,其在 22 年累计客户覆盖超过了 90% 的中央部委、80% 央企、95% 的大型金融机构和 100% 的运营商。通过政企安全业务的发展,深植于政企行业的企业基因自然会促使 360 在大模型发展上更偏向于 To B。而这,对于经营过没有良好政企关系的创业者来说,也许并不见得是一条很好的道路。进一步的,中国的政企的数字化水平相对于美国来说是明显偏低的。在这一波大模型浪潮来临之前,我们也曾经喊过自动化、信息化、数字化和智能化,但是究竟落地到什么程度,身处在行业中的每个人都会有自己的认知。

因此,周鸿祎特地提到「创业者千万不要介入旧系统的改造之中,陷入其中可能长期无法交付。」在国内,每一个做过 To B 的人都知道,一旦深入到某个公司已有的旧系统当中,将会是怎样的深渊。

所以最后总结一下,在我想象里,如果今天你有幸给一个企业做一个行业或者垂直的大模型,你不要试图去解决万能的问题,你不要试图去解决所有的问题,你也不要跟它原来的业务系统糅合地特别紧密,你就是挑一个领域说,我帮你做一个知识管理,或者知识问答的应用。

对于这个问题,百川智能的王小川给出了完全不同的回答,他直接认为在国内 B 端的天花板不高,之后的将投入 C 端的超级应用。

问:百川智能在 B 端和 C 的战略是什么?

答:一家公司不可能把所有赛道都做完。在 B 端,我们选择先做开源模型,B 端企业和中间层的公司,比如做模型二次开发的公司,可以基于这个模型去适用场景。我们的逻辑是我们不去一步做到底,保持足够开放。

C 端的话,今年内部团队开始部署 C 端的超级应用。我们在思考如何追上 GPT-4,思考大模型到底能给 C 端带来哪些应用,同时我们了解到网信办发牌照放行的工作今年一定会被放开。

In The Loop 的认知与王小川的这个回答更为接近,在国内 To B 并不是一个纯粹的产品或者技术问题,很多时候还要考虑到渠道、服务、政企关系等方方面面的事情,想要在 To B 方向喝到汤,进入的门槛实际上非常高。

问:怎么看大模型在 B 端市场的前景?

答:我认为 B 端天花板不高,但确定性是挺清楚的,就是确实很多企业都有这样的一个需求,只是它的对接门槛很高,每个企业有自己的私有数据跟你怎么连。所以如果你没一个好的合作模式的话,最后可能把双方都拖垮掉。一个是信任的问题,一个是 To B 到后面的一个研发成本会非常高。

并不是说 To B 方向不能做,事实上,当前大模型的头部玩家,不论是智谱、Minimax 还是百川智能,都开放了自己 To B 的能力,比如智谱与建行的合作,再比如 Minimax 与金山 WPS 的合作,都是大模型 To B 的典型案例。只是说,大模型创业公司入局 To B 更多的或许是为了构建自己的基底。通过入局 To B,有了订单,可以更快的跑通自己在数据、训练、微调、部署、推理等上下游链路。与此同时,通过和不同行业的企业合作,大模型创业公司不仅可以获得更多的行业 know-how,不仅仅是「行业是什么」,「行业应用应该怎么做」,进一步的还能在落地实践中收获自己的大模型应用抽象方法论和经验3。

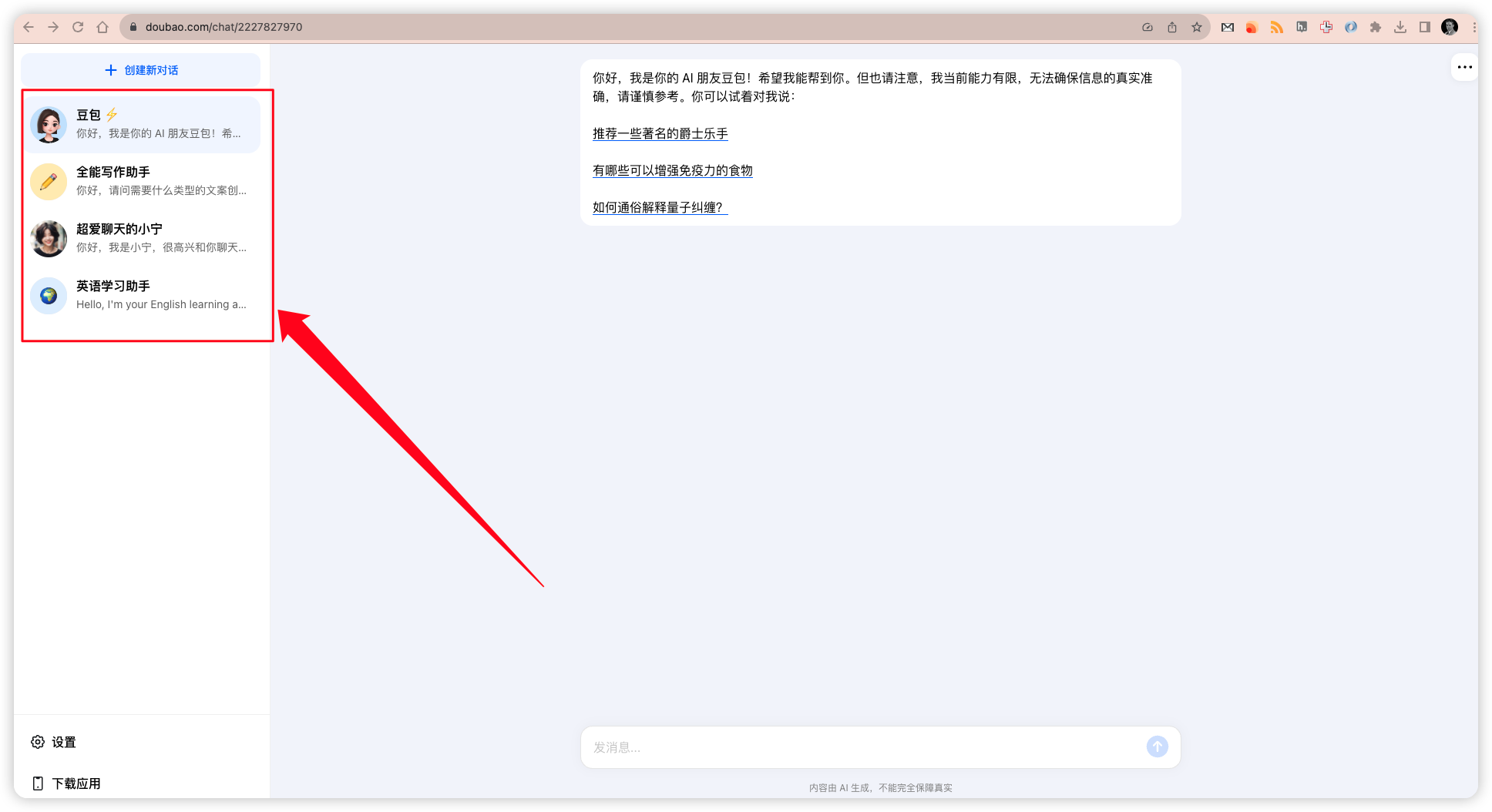

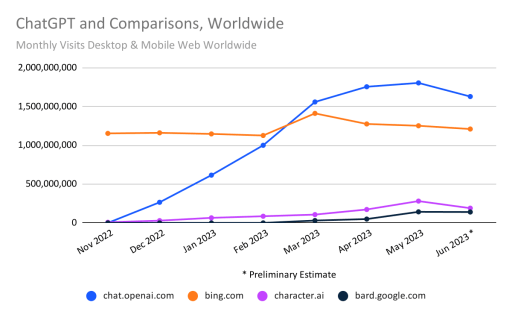

要想真正打开想象空间,也许 To C 才是一条更好的道路。赢得超过 15 亿月活用户的 ChatGPT 也许可以称得上是目前最奇特的产品了,它其实并没有太多的产品设计,只能说是 OpenAI 超强语言模型的一个展示其强大能力的 demo。一个真正优秀的产品绝不应该是这样的,普罗大众的用户并不会太想去学习如何写 Prompt。字节的大模型产品「豆包」相对 ChatGPT 则又近了一步,除了和 ChatGPT 一样最简单的通用聊天框,还进一步封装了小红书文案创作助手、英语学习助手和类似于 Glow 的拟人化情感数字人。

然而,这还远远不够。具备多模态能力的大模型已经展示了巨大潜力,AutoGPT 这类 Agent 应用也激发了人们对于大模型未来应用的想象力。不论是 OpenAI 的代码沙箱应用 Code Interpreter4,还是想要做下一代问答引擎的 Perplexity5,都已经带给了我们巨大的惊喜。对于新技术,「我们总是高估未来两年的变化,低估未来 10 年的变革」。大模型的巨大潜力为我们设计下一代 AI Native 的应用的交互带来了更多的可能性,除了继续依附在个人电脑或者智能手机已有的计算设备进行应用的探索,或许结合类似于 Apple Vision Pro 这样新一代的空间计算设备将会探索出更多充满想象力的应用。

狂飙半年后,2023 下半年应用层能否爆发

2023 上半年看过太多关于 LLM 和 AGI 相关的科技新闻之后,人们也许开始感到厌倦,甚至 ChatGPT 的月活用户开始减少,引发了人们对于这一次 AI 浪潮的质疑6。会不会像这段时间引发热议的「室温超导体」 LK-99 7一样,所谓的大模型是否真的能够给予人们那些「被承诺」的美丽新世界?

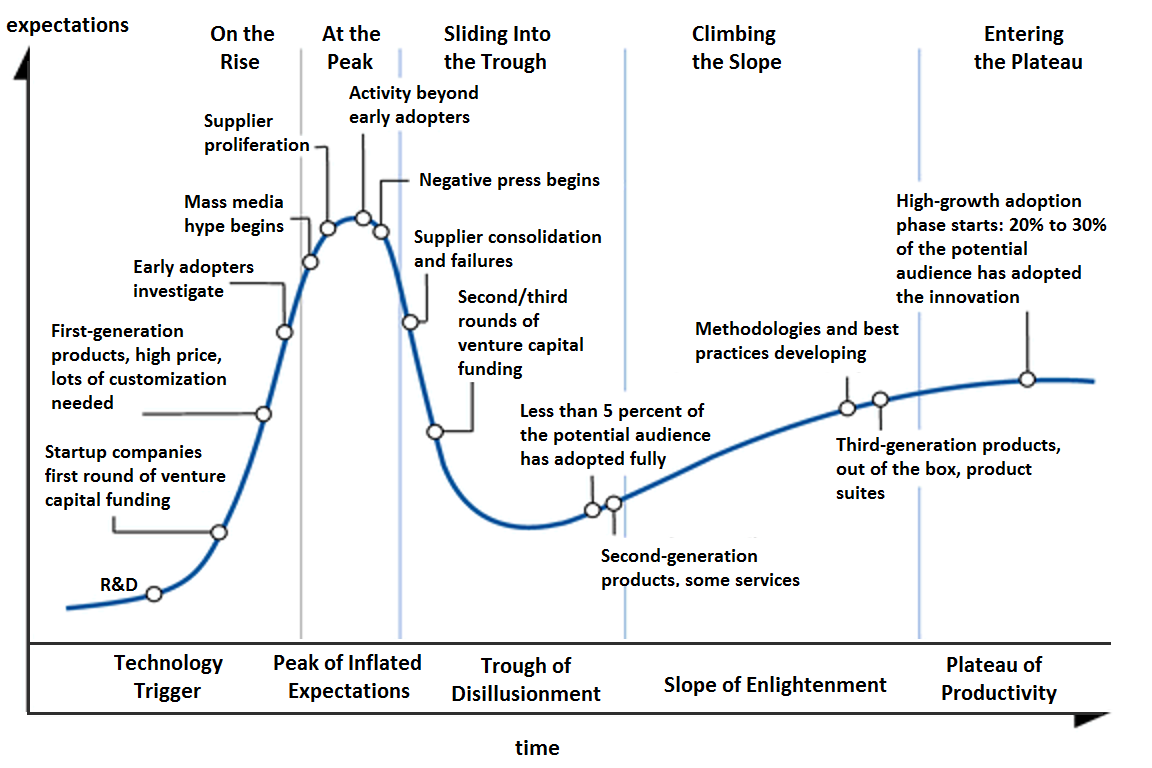

但是,如果你熟悉 Gartner Hype Cycle8 的话,你对这一切则会习以为常了。不论是本世纪初的 dot com 泡沫,还是新能源汽车产业的发展,都能看到 Gartner Hype Cycle 的影子。当有新的革命性技术突破的时候,人们在早期总会投入过于乐观的想象,这种乐观情绪会助长媒体的喧嚣和投资的泡沫。然而,新的革命性技术从被发明到被真正落地到大规模应用中,期间往往存在着各种需要克服和改变的问题,因此对此不太熟悉的人们因为听多了太多媒体鼓吹的美好未来,面对实际使用上的种种问题,热情开始消失,失望开始积累,并进入幻灭低谷期,随之媒体情绪开始转换,投资开始在这一领域也开始减少。

然而,只要大的趋势正确,所有的这一切都会继续草蛇灰线地继续向前发展,并最终王者归来。对于本次大模型的发展,In The Loop 认为也将会如此。果不其然,进入七月,第一款真正意义上破圈的现象级生成式 AI 产品「妙鸭相机」开始出现在人们眼前。

妙鸭是阿里大文娱孵化的内部项目。ChatGPT 掀起新一波 AI 浪潮之后,张月光拉上几名同事今年 2 月建了一个「AIGC 破壁小组」的内部群,用 1 个月的时间讨论出了「写实人像」这个项目方向,再用 3 个月的时间打磨出了「妙鸭」这个具体的产品。9

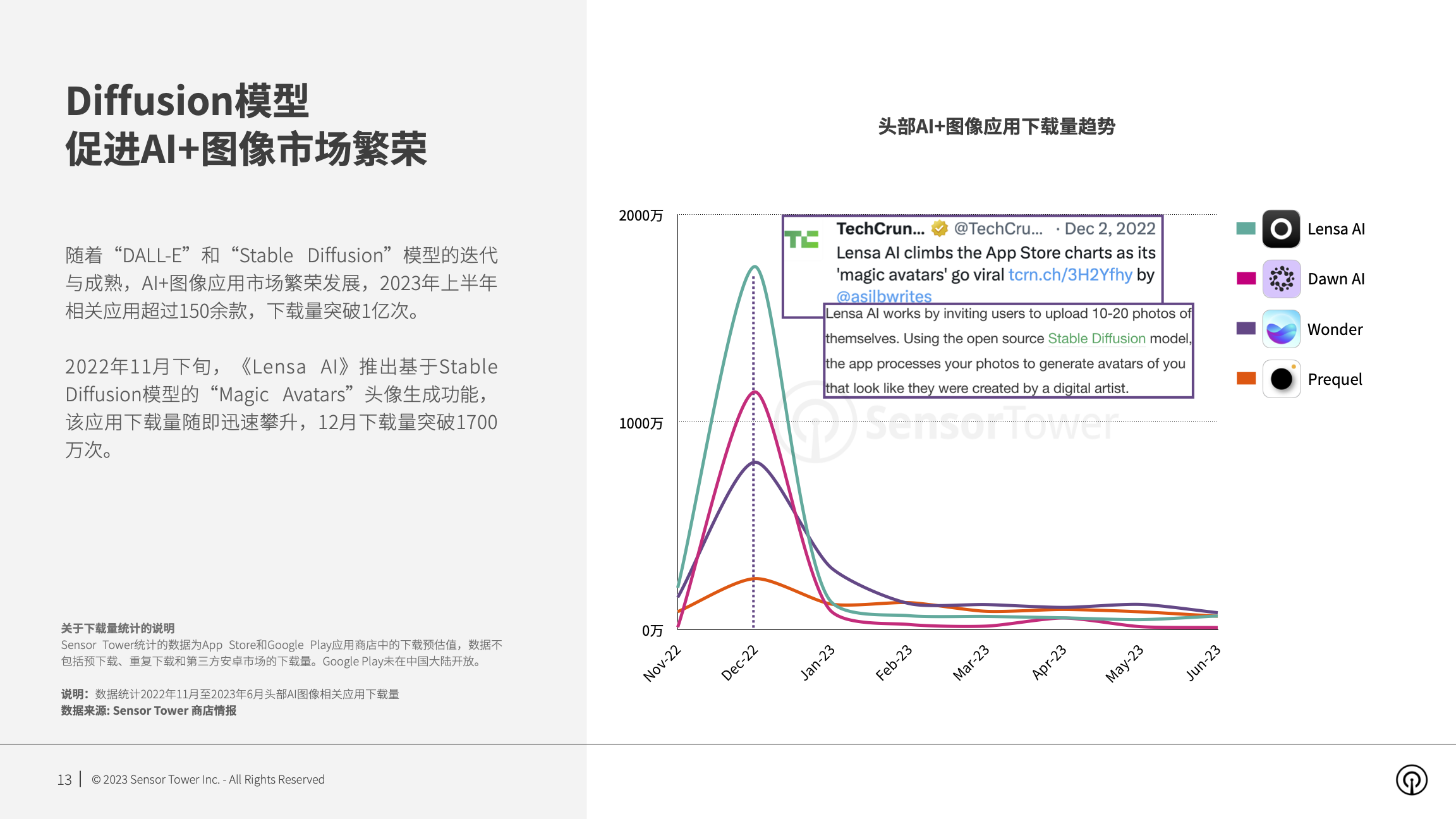

可以看到,妙鸭的成功绝非偶然,感受到这一波 AI 浪潮之后,从产品立项方向论证,到产品开发与打磨,再到推出市场获得成功,妙鸭的每一步都走的很扎实。尽管妙鸭选择的领域是目前已经成熟的写实人像上,尽管因为隐私条款也曾引起争议,尽管国外去年底就已经有类似的产品 Lensa10,尽管妙鸭底层技术可能就是目前已经相对比较成熟的搭配了 LoRA 插件的 Stable Diffusion 模型,毋庸置疑,妙鸭就是一款非常成功的产品。妙鸭成功捕捉了拍写真这一场景的痛点,只需 9.9,不再需要专门去海马体这类线下写真店,直接在线上操作即可生成不输于海马体的写真质量,这样的 9.9,何乐而不为。

妙鸭是第一个出圈的大模型应用,但不会是唯一一个,2023 年的下半年很有可能将会是大模型应用集中爆发的时间。经过上半年「生成式人工智能服务管理暂行办法」11 的尘埃落定,关于生成式人工智能监管的边界已经划定。从 2023 上半年或者更早开始组建团队开始立项研发,到下半年很多应用基本已经准备的差不多了,即将或者正在进入市场,这几天发布的字节「豆包」和「快手 AI 对话」即是典型案例。

这篇文章12 详细总结了在生成式 AI 这一领域各种可能的应用方向。无论是医疗、教育和金融,还是生产力工具、内容创作、虚拟数字人领域,每一个方向都可能蕴藏着巨大的机会。受限于篇幅,本文不可能对每一个方向都展开讨论,只会重点讨论目前比较看好的游戏领域,又或者虚拟数字人这个方向。

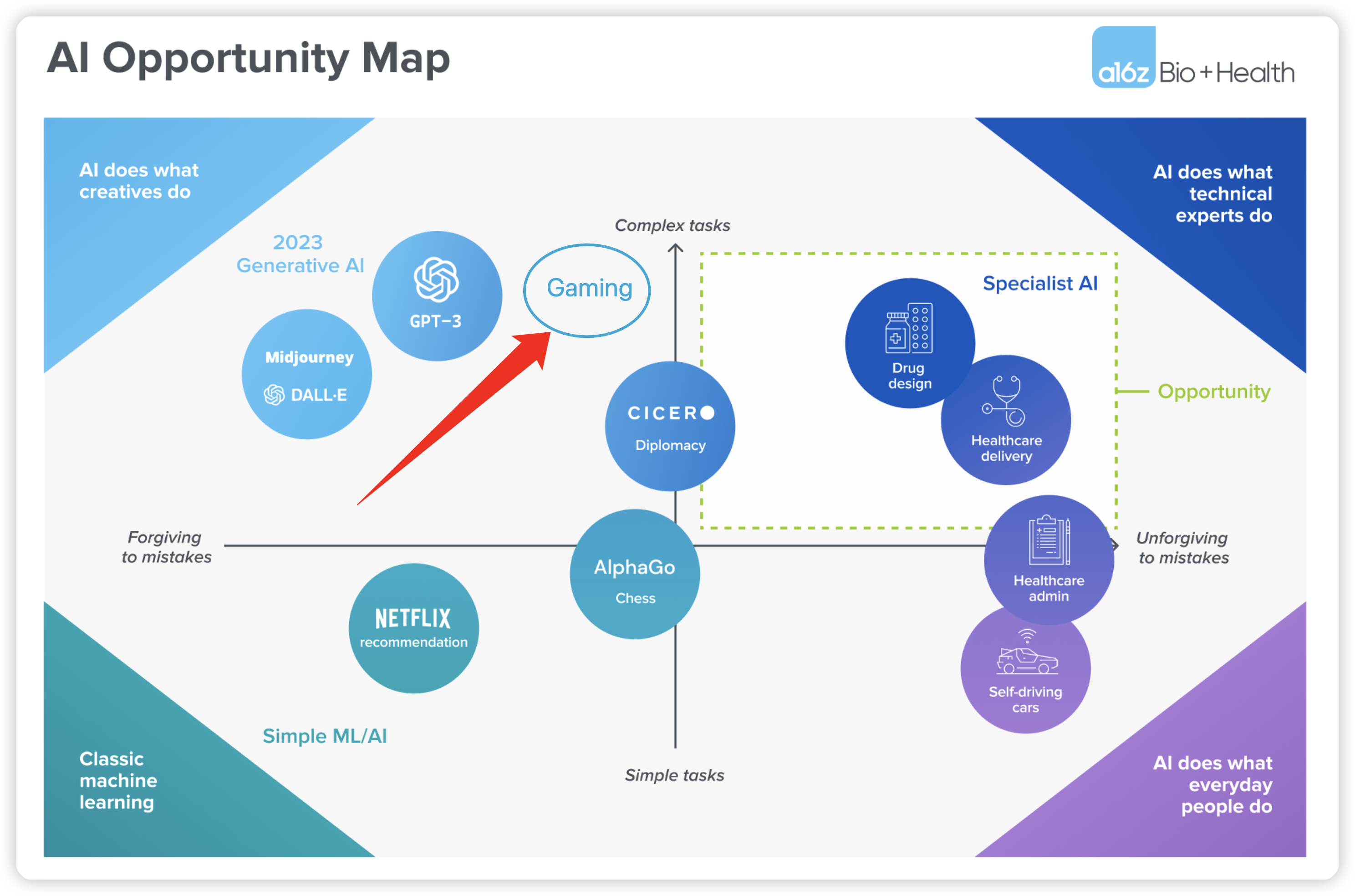

为何会看好游戏或者虚拟数字人这一领域?借用 A16z 的这张原本用来讲生物制药领域 AI 机会的图片,我们可以按照任务的复杂度和对于错误的容忍度这两个维度把 AI 领域的创业机会分成四个象限:

- 容忍度高且任务相对简单的象限中,目前应用最广的即是在各大互联网公司得到应用的搜索、广告和推荐技术。

- 容忍度低且任务相对简单的象限中,典型代表即是曾经被人们保佑最大期待的自动驾驶行业。

- 容忍度低但是任务相对复杂的象限中,不论是生物制药还是金融领域的智能决策都是典型代表。考虑到目前大模型存在的难以解决的幻觉问题,这个象限的机会收益很大但是也相对较难。

- 最后一个象限即是容忍度相对没那么高,可以允许幻觉问题的干扰,任务也可以相对复杂,做更多有意思的事情。在这里我把游戏领域或者虚拟数字人领域放在这个象限。

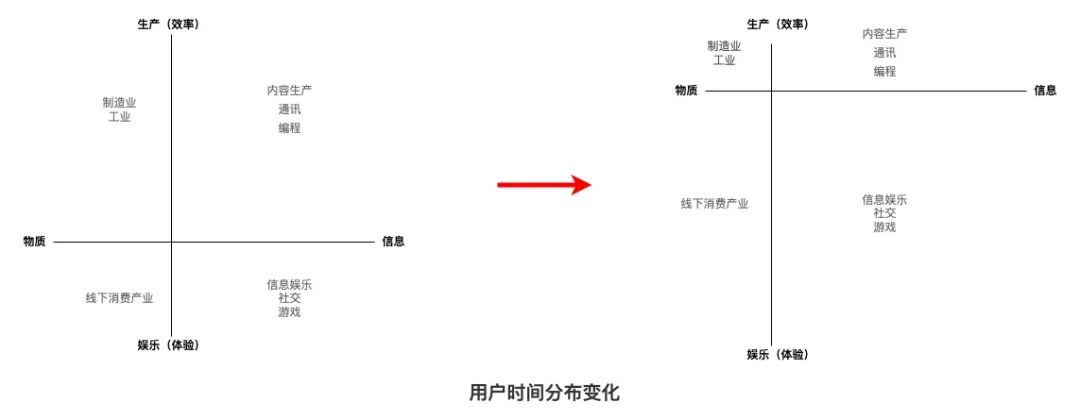

另一个角度思考,选择大模型领域创业,「首先要明确做的是 killing time 的场景,还是 making money 的场景,一个是追求体验,一个是追求效率,不可混淆」2。如果说,所有的应用都是在竞争用户的时间,那么用户的时间分布在什么方向则是你需要重点考虑的问题。是分布在生产效率端还是分布在娱乐体验端,是重物质还是重信息?下图是音遇创始人 Albert 对于未来用户时间分布变化的思考2,如果你认可这一时间分布的变化,那么在未来更大的机会可能还是在信息娱乐、社交和游戏这些方向。

腾讯互娱的这篇文章13 非常详尽地讨论了 AIGC 将会对游戏行业产生的影响,A16z 的这篇文章14也展望了生成式 AI 可能创造的新游戏品类,强烈推荐阅读。

从算力平台到中间层,谁能赚到卖铲子的钱

在每一次由科技革新带来的商业化浪潮中,有亲身投入浪潮中淘金的人,也有专门给弄潮儿们卖铲子的人。这些卖铲子的典型代表,有移动互联网浪潮中通过卖 iPhone 和 App Store 收数字税的苹果公司,有新能源汽车浪潮中卖新能源电池的宁德时代,当然还有这次生成式 AI 浪潮中卖算力的英伟达。

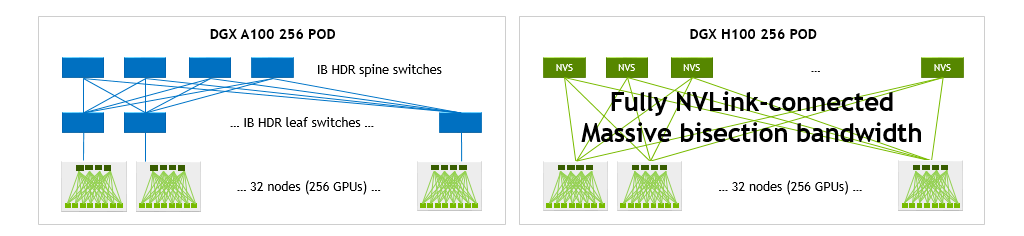

NVIDIA 无疑是这次浪潮中的最大赢家,它凭借 GPU + NVLINK + Infiniband 的组合拿走了市场 90% 的蛋糕。当前 NVIDIA 最新一代 H100 售价约 3.5 万美元,折合人民币约 25 万人民币。目前市场上对于 H100 的需求约在 43.2 万张左右,总价值约为 150 亿美元,这其中还不包括中国公司大量采购的 H80015。这些需求广泛来自各大云厂商,以及需要训练大模型的创业公司。

受限于台积电产能,目前 NVIDIA 能够供给的 GPU 数目是大大小于需求的。在需求大于供给的情况下,基于 NVIDIA 强势的市场地位,NVIDIA 甚至可以决定优先给哪家公司供给 GPU。针对那些试图直接与其竞争的公司,比如推出自研推理和训练芯片 Inferentia 和 Tranium 的 AWS,比如推出 TPU 的 Google,比如推出 Project Athena16 的 Azure。

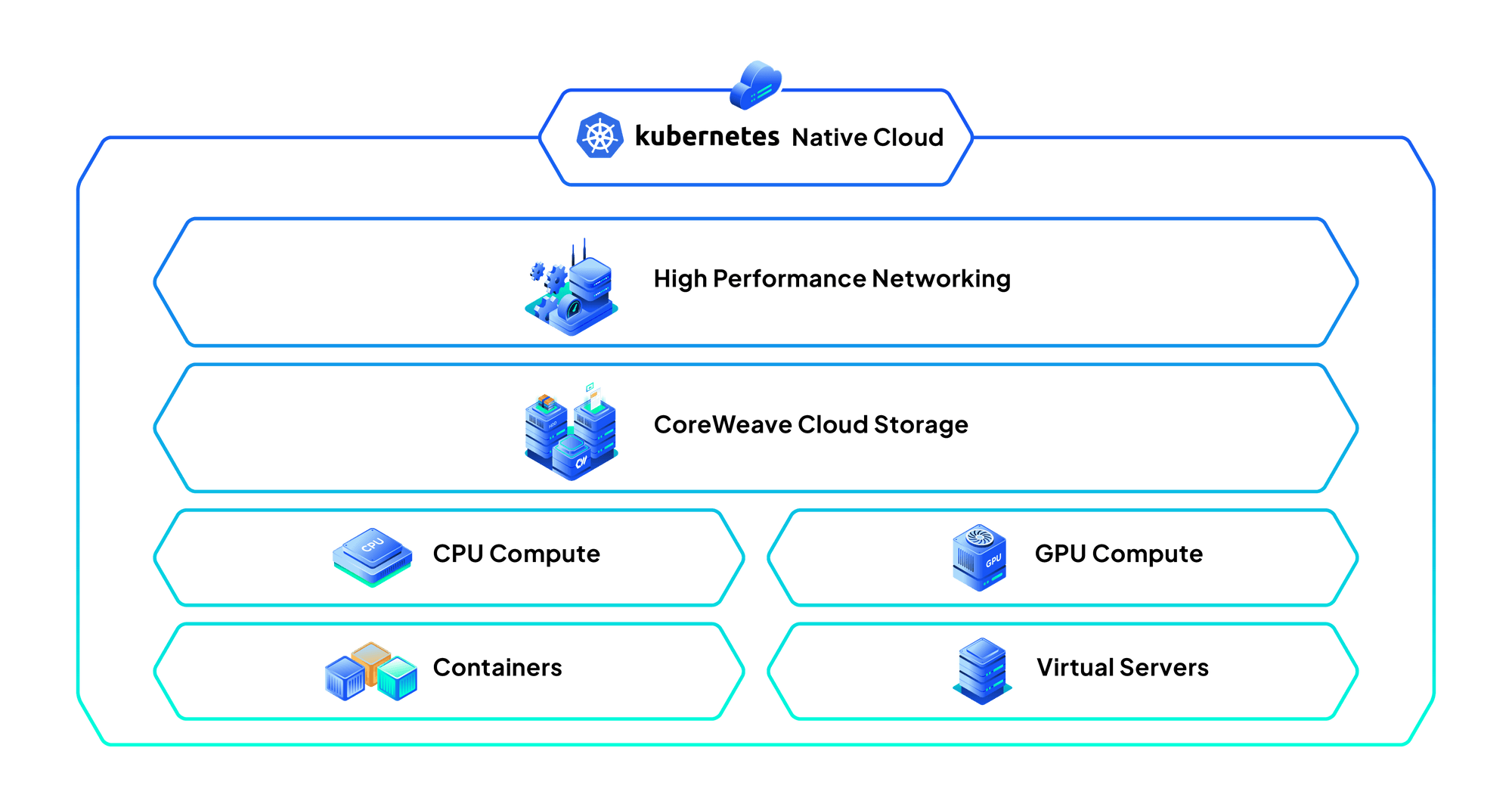

作为 NVIDIA 投资的中小型云服务商 CoreWeave,从 NVIDIA 那里最早并且获得最多 H100,其在 23 年 3 月 21 日即宣布其客户 NovelAI 已经上线开始使用 H10017。AWS 直到 6 月 26 日才在博客正式宣布其新一代 H100 实例 p518,Azure 直到 8 月 7 日才在博客正式宣布其新一代 H100 实例19,截止到本文发布,GCP 仍然没有正式发布其新一代 H100 实例。凭借对 GPU 资源的合理分配,NVIDIA 成为了实际意义上的云计算市场操盘手。

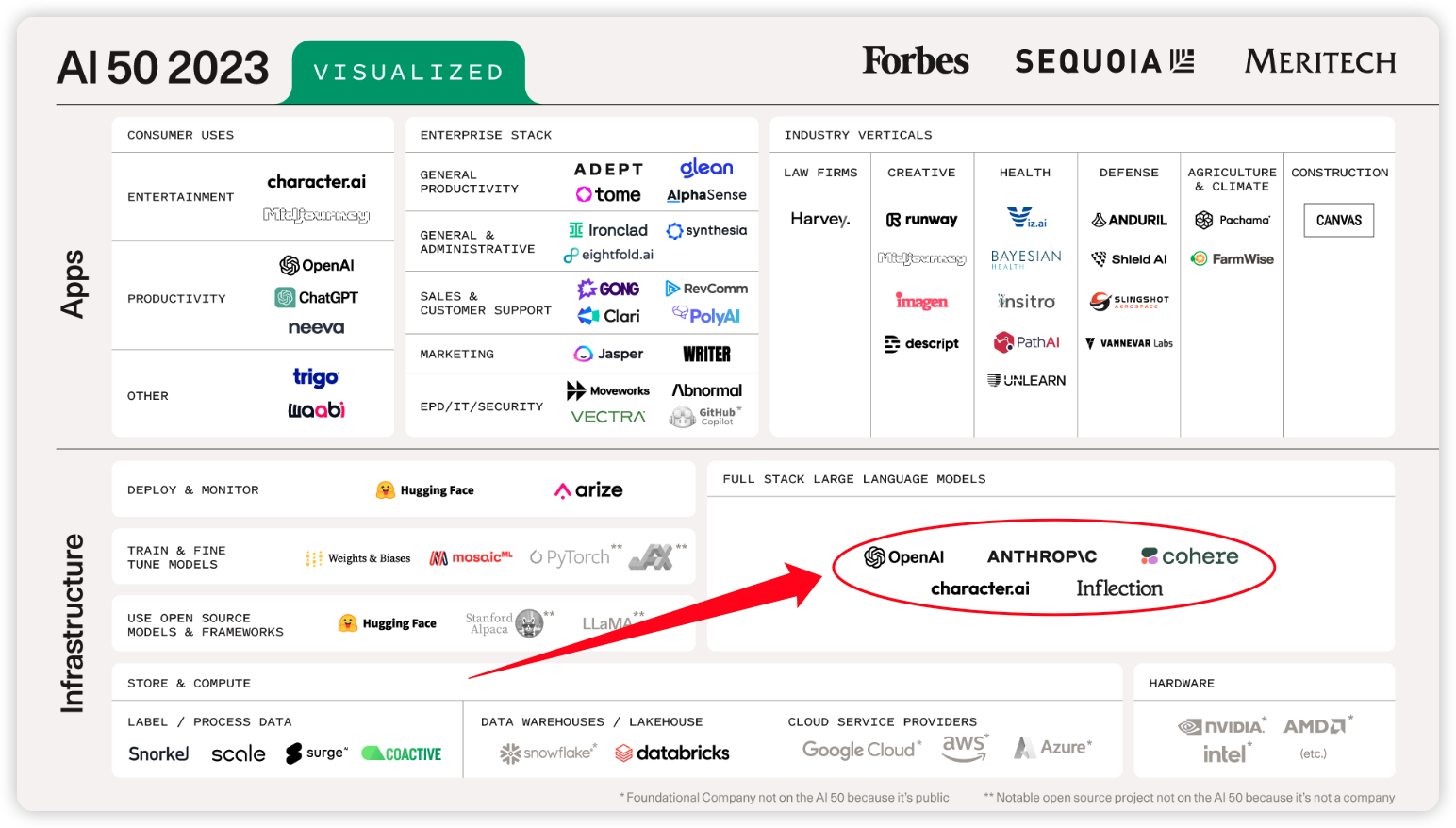

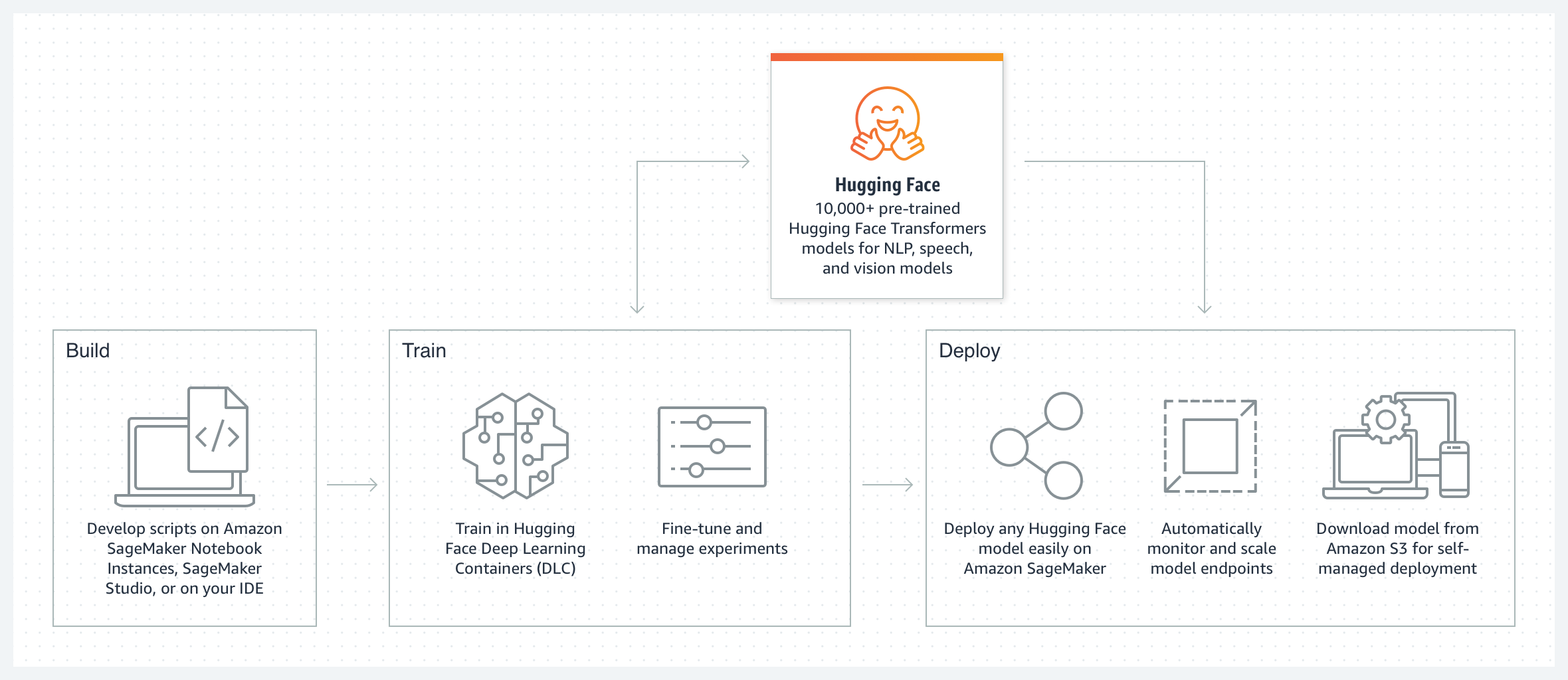

尽管如此,各大云厂商仍然想在此波大模型浪潮中赚到卖铲子的钱20。参与浪潮的第一步是吸引大模型的主要玩家进入自己的算力平台,比如微软 Azure 与 OpenAI 与 Meta 的 LLaMA 合作、谷歌云 GCP 选择与 Anthropic 和 Cohere 等公司合作21,亚马逊 AWS 也宣布与 Hugging Face 还有 Stability AI 等公司合作。这一点在国内也基本类似,比如 Minimax 之于火山引擎等。

除了吸引当前主要玩家入驻,云厂商还同步发布了一批生成式 AI 工具,以加速构建生成式 AI 应用的大型语言模型和大型视觉模型的训练、微调和部署。以 AWS 为例,他们发布了 Bedrock 和 CodeWhisperer 以及新的推理和训练机型22。

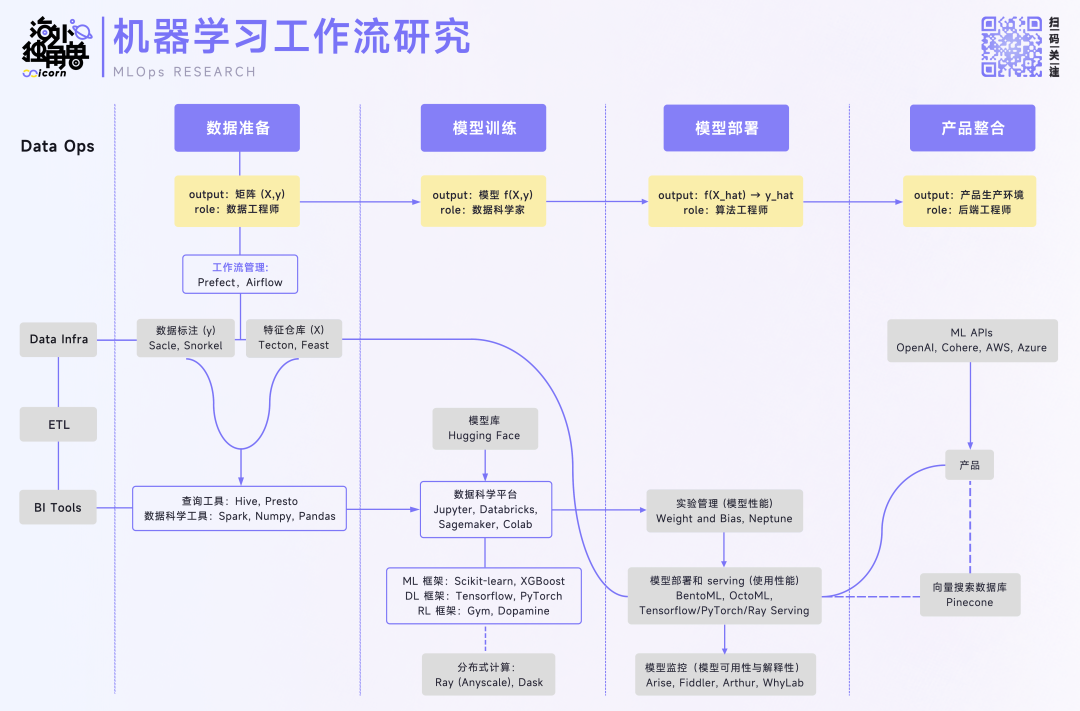

除了像 NVIDIA 这样提供 GPU 与网络设备的硬件厂商,以及 AWS/Azure/GCP 这样的云计算厂商,还有一大批中间层玩家期望在大模型的应用中赚到卖铲子的钱。中间层,即是从最底层的模型和算力,到最上层的应用层中间的那些玩家,他们围绕着机器学习 Pipeline 的各个环节,提供各种平台方便客户更好的准备数据、训练模型和部署模型,以及还包括产品整合。这篇文章23 非常详细阐述了在中间层活跃的各个公司产品及其应用场景,此处不再赘述。

最后,在算力硬件的部分,除了大家用的最多的 NVIDIA 的 GPU 和网络设备,其实还有很多基于 ASIC/FPGA 等形态的加速器和基于 CXL 的互联方案的环节,这篇文章24 非常详尽的介绍了这一领域,相当硬核。

移动互联网时代远去,2022 会是 2007 吗

在 Founder Park AGI 大会开场时,张鹏提出了一个论断「2022 更像 2007」,其核心论点是:2007 年,iPhone 发布揭开了智能手机的时代,2010 年,iPhone4 的发布和普及掀起了移动互联网应用的浪潮。2022 年以 MidJourney 和 ChatGPT 为代表的大模型应用产品的发布揭开了 AGI 的时代,这只是一个开始。这一切都还在迅猛发展着,两三年之后,我们终将会迎来大模型领域的 iPhone4 时刻。

也许是 10 年前移动互联网的创业浪潮给大家留下了太深的印记,现在很多人在讨论目前大模型行业,会拿移动互联网和智能手机做比喻:

- 大模型就像是智能手机操作系统,最后只会有类似于闭源的 iOS 和开源的安卓两套系统,其他的都会被淘汰在生态之外

- 大模型就像是智能手机,尽管美国最先发布了 iPhone,我们仍然可以有自己的华为、小米、Oppo 和 Vivo

In The Loop 目前更倾向于第二种比喻,又或者这一切是将会是完全不一样的故事。两三年后,所有的这一切竞争与博弈将会初见分晓,到那时不知我们将会以怎样的心态来看待这一段故事。

前几天国内 7 月份经济数据发布,普遍低于预期。整体宏观总需求不足,微观主体信心不足,经历三年疫情之后本来期待在放开之后迅速振兴的经济修复动能不足。经济形势十分严峻,青年人的失业率居高不下,整个社会氛围开始愈加保守。2023 年的状况让我不禁想到了 2008 年,那会儿的中国面临着来自美国次贷危机引发的全球金融危机也十分艰难,外贸订单大幅减少,沿海工厂停工停产。

如果说 2022 年更像 2007 年的话,当前的形势确实也很符合,那么我真心希望这是真的。在经济周期低谷中孕育的新技术,很有可能通过技术爆发带来下一轮经济周期的增长。也许有人会说很多情况已经发生了改变,「2022 更像 2007 」也不能如此简单的套用。作为乐观主义者,依然相信未来类似于大模型这样的新技术会带来大量机会。正如在 Founder Park AGI 大会见证的一幕,一个 13 岁的少年主动提问「硅基生物能否创造出比碳基生物更有趣的游戏,能不能不用人类提示自动化产出游戏」。少年的提问令我惊讶也惊喜,这一幕也仿佛在告诉我们:

希望总在未来。

-

Meta and Microsoft Introduce the Next Generation of Llama, 2023-07-18, https://ai.meta.com/blog/llama-2 ↩︎

-

到底有没有人在投 AI?AI 赛道第一线实操体感分享,42 章经, https://mp.weixin.qq.com/s/UiiYscg1QXp34ecbHnOJNQ ↩︎ ↩︎ ↩︎

-

大模型赛道的技术和应用分析,马丁, https://whjlnspmd6.feishu.cn/wiki/DBnWwik1piTB6Iki02CcXoVQn3S ↩︎

-

Code Interpreter, OpenAI, https://chat.openai.com/?model=gpt-4-code-interpreter ↩︎

-

Perplexity, https://www.perplexity.ai ↩︎

-

ChatGPT loses users for first time, shaking faith in AI revolution, The Washington Post, https://www.washingtonpost.com/technology/2023/07/07/chatgpt-users-decline-future-ai-openai ↩︎

-

LK-99 isn’t a superconductor — how science sleuths solved the mystery, Nature, 2023-08-16, https://www.nature.com/articles/d41586-023-02585-7 ↩︎

-

Gartner Hype Cycle, https://en.wikipedia.org/wiki/Gartner_hype_cycle ↩︎

-

对话「妙鸭」产品负责人:AIGC 的产品第一天不收钱,就可能收不到钱,极客公园, https://mp.weixin.qq.com/s/x7L-hfvO55qNWX_cu-HdHw ↩︎

-

Lensa, https://prisma-ai.com/lensa ↩︎

-

生成式人工智能服务管理暂行办法, http://www.cac.gov.cn/2023-07/13/c_1690898327029107.htm ↩︎

-

Top 100+ Generative AI Applications / Use Cases in 2023, https://research.aimultiple.com/generative-ai-applications ↩︎

-

一篇文章讲透——AIGC 会如何颠覆游戏行业?腾讯互动娱乐游戏策划 17, https://mp.weixin.qq.com/s/6_ESLXrk1ge0BUefAiCJcA ↩︎

-

The NeverEnding Game: How AI Will Create a New Category of Games, a16z, https://a16z.com/2023/07/19/the-neverending-game-how-ai-will-create-a-new-category-of-games ↩︎

-

H100 供需分析:芯片战争将持续多久? https://mp.weixin.qq.com/s/arwikTbqsGv8hBb4aqaXMA ↩︎

-

https://www.theverge.com/2023/4/18/23687912/microsoft-athena-ai-chips-nvidia ↩︎

-

CoreWeave Announces NovelAI as Among the First to Have NVIDIA HGX H100 GPUs Online, 2023-03-21, https://www.coreweave.com/blog/coreweave-announces-novelai-as-among-the-first-to-have-nvidia-hgx-h100-gpus-online ↩︎

-

New – Amazon EC2 P5 Instances Powered by NVIDIA H100 Tensor Core GPUs for Accelerating Generative AI and HPC Applications, 2023-06-26, https://aws.amazon.com/cn/blogs/aws/new-amazon-ec2-p5-instances-powered-by-nvidia-h100-tensor-core-gpus-for-accelerating-generative-ai-and-hpc-applications/ ↩︎

-

Scale generative AI with new Azure AI infrastructure advancements and availability, 2023-08-07, https://azure.microsoft.com/en-us/blog/scale-generative-ai-with-new-azure-ai-infrastructure-advancements-and-availability/ ↩︎

-

财新周刊|云厂商开战大模型,2023-06-19, https://weekly.caixin.com/2023-06-17/102066833.html ↩︎

-

https://cloud.google.com/blog/products/ai-machine-learning/building-an-open-generative-ai-partner-ecosystem ↩︎

-

Announcing New Tools for Building with Generative AI on AWS, 2023-04-13, https://aws.amazon.com/blogs/machine-learning/announcing-new-tools-for-building-with-generative-ai-on-aws/ ↩︎

-

拾象 AI 投资图谱:大浪已至,展望 Infra 百亿美金公司机遇, https://mp.weixin.qq.com/s/uBIpXFloAoda5lrquzyvDg ↩︎

-

拾象 AI 投资图谱:挖掘 AIGC 军火产业链,颠覆巨头的机会和风险, https://mp.weixin.qq.com/s/bVQYT0QqueGyLwPAppDRtg ↩︎

alipay

Author houminwei

Publish August 21, 2023

LastMod February 15, 2024

License 本作品采用 CC BY-NC-ND 4.0 许可协议进行许可,转载时请注明原文链接

如果你在浏览博客的过程中发现了任何问题,欢迎在对应文章下评论。如果你有其他事情想要咨询,可以通过邮件联系我。